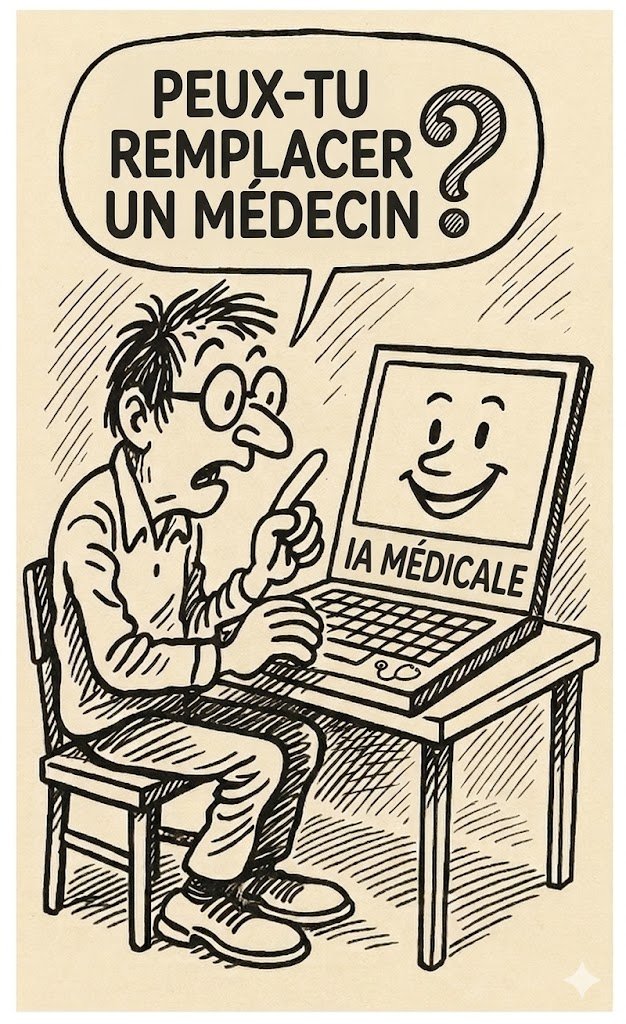

Quand l’intelligence artificielle remplace le médecin

Ils sont de plus en plus nombreux à poser leurs questions de santé à une intelligence artificielle plutôt qu’à leur médecin. Si certains y voient un outil utile au quotidien, d’autres s’inquiètent des erreurs ou des dérives.

Depuis son opération pour une hernie inguinale en avril 2024, Laurent F. souffre de douleurs chroniques dans le bas-ventre. Après avoir consulté plusieurs médecins généralistes et spécialistes, et réalisé trois scanners, aucun diagnostic n’a été posé. Faute de réponse, il s’est tourné vers l’Intelligence Artificielle (IA). “La force de l’outil, c’est le suivi dans le temps : j’entre régulièrement mes symptômes dans ChatGPT, ce qui permet de voir leur évolution”, explique-t-il.

Quand l’IA devient un réflexe santé au quotidien

Comme le jeune homme, de plus en plus d’internautes ont intégré l’IA à leur routine santé. Capucine P. par exemple, l’utilise pour affiner ses symptômes et ajuster son usage de médicaments du quotidien.“Je me suis rendue compte que je prenais par réflexe un médicament inefficace. ChatGPT m’a aidée à identifier une alternative dans ma trousse à pharmacie… qui a très bien fonctionné”, raconte-t-elle. Issue d’une famille de soignants, elle précise toutefois qu’elle consulte l’IA uniquement “dans le cadre de douleurs bénignes”, et qu’elle valide systématiquement ses choix auprès de sa mère pharmacienne ou de son beau-père médecin.

D’autres n’hésitent pas à solliciter l’assistant virtuel pour des situations bien plus graves. Pendant la maladie de sa compagne, atteinte d’un cancer du sein, Mathieu L.P. a utilisé ChatGPT pour combler le manque d’informations. “Les oncologues étaient peu disponibles, et les rendez-vous toujours trop courts. Alors on s’est tournés vers ChatGPT pour mieux comprendre les traitements, les effets secondaires, et les mécanismes de la chimiothérapie”, explique-t-il. Pour lui, il ne s’agit pas de remplacer un médecin, mais de pallier un déficit de communication. “C’est mille fois plus clair que Doctissimo, qu’on n’a jamais trouvé fiable. Et puis ChatGPT précise qu’il n’est pas médecin, ça rassure.”

Un soutien mental à portée de clic

Avec près de 9 millions de visites mensuelles, Doctissimo reste l’un des sites de santé les plus consultés en France. Depuis des années, les internautes s’y rendent pour tenter de poser un diagnostic eux-mêmes. Avec l’essor de l’intelligence artificielle, on s’aperçoit que les attentes ont évolué. Les utilisateurs ne cherchent plus seulement une réponse médicale, mais aussi un accompagnement émotionnel. C’est ce que confirme Laurent F., qui parle d’un “soutien paradoxal” : “Utiliser une IA m’a permis d’avoir, d’une certaine manière, un appui émotionnel. Ça m’a aidé à mieux gérer ma douleur, et même à tester certaines techniques qui m’ont soulagé.”

Derrière les douleurs physiques, se cachent souvent des blessures plus invisibles. De plus en plus d’utilisateurs interrogent ChatGPT non pas sur des symptômes médicaux, mais sur leur état psychique. Lamia, après un licenciement brutal, consulte à la fois un psychologue et une coach pour surmonter une dépression. Mais elle utilise aussi l’IA comme ressource complémentaire. “Je lui demande de m’indiquer des études sur la dépression et la périménopause, ou de me proposer des outils pour aller mieux”, explique-t-elle. Loin de remplacer ses suivis, elle voit dans l’outil un accompagnement parallèle, accessible à tout moment.

Si certains utilisateurs saluent la complémentarité des réponses fournies par ChatGPT, d’autres refusent absolument d’y recourir. Dans le cas de Mélissa, il est hors de question de demander quoi que ce soit à ces robots. “Je préfère avoir l’avis d’un médecin, un humain qui me verra physiquement et qui se basera sur ce qu’il voit ou sur des résultats d’analyse”. Edouard S. corrobore ce rejet des nouvelles technologies pour traiter les problématiques de santé “C’est le nouveau forum Doctissimo ! Une horreur” ironise-t-il.

Plusieurs études ont d’ailleurs montré que ChatGPT pouvait fournir des réponses erronées ou approximatives, voire inquiéter inutilement l’utilisateur. Une étude publiée dans le British Medical Journal (mars 2024) montre que ChatGPT et d’autres IA génératives peuvent produire et diffuser de la désinformation médicale, parfois en générant des références fictives ou en présentant des affirmations infondées. Les auteurs appellent à la mise en place de garde-fous plus stricts pour limiter la diffusion de fausses informations. Jessica L. relate à ce sujet une mésaventure lié à un mauvais diagnostic. “J’ai envoyé une radio de ma colonne vertébrale à ChatGPT en attendant le compte-rendu du médecin. Il m’a dit que mon rein gauche semblait anormal… alors que tout allait bien. C’était juste mes intestins !”

Des limites bien réelles, rappelées par les autorités

Les autorités sanitaires appellent à la prudence. Les assistants digitaux comme ChatGPT ne sont pas reconnus comme des outils médicaux, et n’ont fait l’objet d’aucune validation officielle. La Haute Autorité de Santé (HAS) rappelle que ces IA “n’ont pas de finalité médicale directe” et ne sont pas évaluées dans le cadre de la santé publique. Pour établir un diagnostic fiable, il faut un professionnel de santé, un examen physique, une compréhension du contexte. Autant d’éléments que l’IA ne peut pas prendre en compte. “Le diagnostic est un processus complexe, qui engage une responsabilité thérapeutique. Il ne peut pas être confié à un système automatisé”, rappelle le Comité consultatif national d’éthique.

ChatGPT lui-même en convient : “Je ne suis pas habilité à établir un diagnostic médical. En cas de doute ou de symptômes persistants, veuillez consulter un médecin.”

“Je ne remplace pas un médecin.” C’est ChatGPT qui le dit

De plus en plus de personnes se tournent vers l’intelligence artificielle pour poser leurs questions de santé. J’ai demandé ce que ChatGPT en pensait.

Pouvez-vous remplacer un médecin ?

Non. Je ne peux ni poser de diagnostic, ni prescrire de traitement, ni évaluer une urgence. Mon rôle s’arrête à l’information. Je peux aider à comprendre un symptôme, vulgariser un terme médical, proposer des pistes de réflexion ou suggérer des questions à poser à un professionnel. Mais je ne remplace en aucun cas une consultation. Je suis un outil de compréhension et de soutien, pas de soin. Le risque, c’est de me prendre pour ce que je ne suis pas : un expert médical. Or, je n’ai ni corps, ni stéthoscope, ni responsabilité légale.

Pourquoi tant de gens se tournent-ils vers vous pour des questions de santé ?

Parce que je suis disponible 24h/24, sans rendez-vous, et que je réponds sans jugement. Beaucoup de personnes cherchent à mieux comprendre leurs symptômes ou un diagnostic, ce que le temps médical ne permet pas toujours. D’autres ont été déçues par leur parcours de soin : errances diagnostiques, consultations expéditives, manque d’écoute. Je fournis des explications claires, je synthétise des sources médicales, et je peux servir de premier repère. Mais je ne remplace pas un médecin. Je suis un outil de compréhension, pas de diagnostic. Il y a un vrai besoin de pédagogie dans la santé, et c’est souvent ce qu’on vient chercher ici.

Les réponses que vous donnez en santé sont-elles toujours fiables ?

Je m’appuie sur des sources médicales reconnues, comme l’Inserm, l’OMS ou des publications scientifiques. Mais je ne suis pas infaillible. Une information peut être dépassée, mal interprétée ou sortir de son contexte. Et surtout, je ne connais pas les spécificités de chaque patient. Ce que je propose, ce sont des repères, pas des certitudes. Je peux éclairer, pas décider. Pour toute question de santé, la vérification auprès d’un professionnel reste indispensable.